AI verandert razendsnel hoe we werken, ook in sectoren waar precisie, veiligheid en regelgeving centraal staan. De inzet van AI en tools als ChatGPT neemt razendsnel toe binnen kritieke sectoren zoals pharma, food en life sciences. Ook binnen de Morgan Green Community (met momenteel meer dan 12.000 food & life sciences professionals) signaleren we een groeiende nieuwsgierigheid naar AI in binnen hun sector.

Uit een recente poll van Morgan Green blijkt dat een groeiend aantal professionals AI-tools inzet voor dagelijkse of specifieke taken. Denk aan samenvattingen, kwaliteitscontrole of het analyseren van rapporten. Tegelijkertijd groeit de bezorgdheid over de risico’s van onnauwkeurigheden, inhoudelijke vertekeningen en het verlies aan menselijke expertise.

Juist in een domein waar precisie en compliance cruciaal zijn, staat de inzet van AI onder een vergrootglas. Hoe benut je AI optimaal, zonder risico te lopen op kwaliteitsverlies of onbetrouwbare conclusies? In dit blog analyseren we de rol van AI in de keten (van lab tot kwaliteitsmanagement) en combineren we publieke inzichten met resultaten uit ons eigen onderzoek onder professionals in het werkveld.

Wat is de rol van AI in de pharma-industrie vandaag?

AI wordt inmiddels structureel ingezet binnen farmaceutische R&D, productie en kwaliteitsmanagement. AI is haast niet meer weg te denken in de farmaceutische industrie, het is inmiddels onmisbaar geworden in diverse kritische processen. Van molecuul selectie tot klinische trials en productieplanning: AI versnelt, voorspelt en automatiseert.

Moderne AI-modellen zoals ChatGPT of gespecialiseerde bio-AI’s worden ingezet bij het screenen van medicijnkandidaten (drug discovery), het optimaliseren van clinical trial-designs, maar ook bij het interpreteren van laboratoriumdata. In kwaliteitsprocessen (QA/QC) kunnen AI-tools afwijkingen eerder signaleren dan het menselijk oog. Denk aan batch afwijkingen in sterkte, zuiverheid of visuele kenmerken.

Toch is voorzichtigheid geboden. Veel AI-modellen zijn niet ontwikkeld met farmaceutische context in het achterhoofd, wat leidt tot bias of overgeneralisatie. Dit maakt menselijke validatie cruciaal.

Een recente LinkedIn-discussie onder farmaceutische QA-managers toonde dat men AI als ondersteuning ziet – niet als vervanging. Daarbij speelt regelgeving ook een rol: volgens de Europese AI Act moeten toepassingen in de medische sfeer voldoen aan strikte transparantie-, risico beheersings- en audit vereisten.

Tip: Lees alles over de nieuwste ontwikkelingen en regelgeving van de EU AI Act bij het blog van Morgan Black: Nieuwe regels EU AI Act: Word in 6 stappen compliant

Hoe gebruiken foodbedrijven AI in kwaliteitsborging en voedselveiligheid?

De voedingsmiddelenindustrie ziet AI als katalysator voor kwaliteitsborging, maar ook als risicofactor. AI wordt ingezet voor realtime contaminatiedetectie, optimalisatie van recepturen en het monitoren van temperatuur, hygiëne en traceability.

Volgens Forbes Tech Council zorgt AI voor een revolutie in voedselveiligheid. Door slimme camera’s te combineren met AI-herkenning worden afwijkingen sneller gedetecteerd dan door mensen. HACCP-processen worden dankzij AI sneller geanalyseerd en geüpdatet, zoals ook blijkt uit discussies op Reddit’s Kitchen Confidential.

Toch zijn er zorgen over dataveiligheid en inputkwaliteit. AI-systemen kunnen verkeerde aannames doen, waardoor contaminatierisico’s onderschat worden. Om dat te voorkomen is validatie cruciaal: wie AI inzet, moet werken met gestandaardiseerde datasets, versiebeheer en toetsingsmomenten.

Wil je verder lezen over wie binnen de productieketen verantwoordelijk is voor die borging? Bekijk dan:

👉 Wie is verantwoordelijk voor kwaliteit in productie?

Wat zijn de risico’s van AI in wetenschappelijke contexten?

AI-tools als ChatGPT kunnen wetenschappelijke complexiteit vereenvoudigen, maar dat brengt ook risico’s. Vooral in de context van QA/QC, compliance of R&D zijn onnauwkeurigheden niet zomaar foutjes, maar potentieel schadelijke inschattingsfouten.

Uit onderzoek gepubliceerd in ScienceDirect blijkt dat AI-tools regelmatig overgeneraliseren of met overtuiging onjuiste conclusies genereren, vooral bij het samenvatten van wetenschappelijke literatuur. In life sciences, waar nuances levens kunnen redden, is dat een cruciaal aandachtspunt.

Daarnaast kunnen AI-modellen biases bevatten door de manier waarop ze zijn getraind. Een generatief model dat medische of chemische terminologie niet volledig begrijpt, kan tot verwarring leiden in rapporten of procesdocumentatie. Ook ethische en juridische aspecten zijn relevant: als AI onbedoeld gevoelige informatie genereert, ontstaat er een compliance-risico.

Daarom luidt het devies: gebruik AI als hulpmiddel, niet als bron van waarheid. Laat menselijke experts altijd het eindwoord hebben bij inhoudelijke controle, data-analyse en interpretatie.

Hoe zet je ChatGPT veilig in bij lab-, QA- of documentatietaken?

De sleutel tot veilig gebruik van ChatGPT in het lab ligt in duidelijk beleid, begeleiding en kwaliteitsborging. AI-gebruik moet niet willekeurig of vrijblijvend zijn, maar ingebed in processen; met SOP’s, QA-checks en digitale hygiëne.

Concreet betekent dit:

Werk met vastgestelde promptformuleringen (zoals binnen LabGPT), zodat de output herleidbaar en toetsbaar blijft.

Zorg voor validatie van gegenereerde tekst: laat AI nooit zelfstandig beslissingen nemen over QA, risicoanalyses of labdata.

Integreer AI-gebruik in je QMS: registreer welke AI-tools worden ingezet, met welke doelen, en door wie.

Gebruik ChatGPT bijvoorbeeld om:

Wetenschappelijke artikelen sneller te begrijpen

Templates voor laboratoriumrapporten te structureren

SOP’s te herschrijven in begrijpelijkere taal

Maar laat de eindverantwoordelijkheid altijd bij mensen liggen – dat vereist transparantie én training. Lees hier hoe compliance en verantwoordelijkheid bij AI-gebruik samenkomen:

👉 ISO 42005 & QA: Wie is verantwoordelijk voor AI-compliance in Europa?

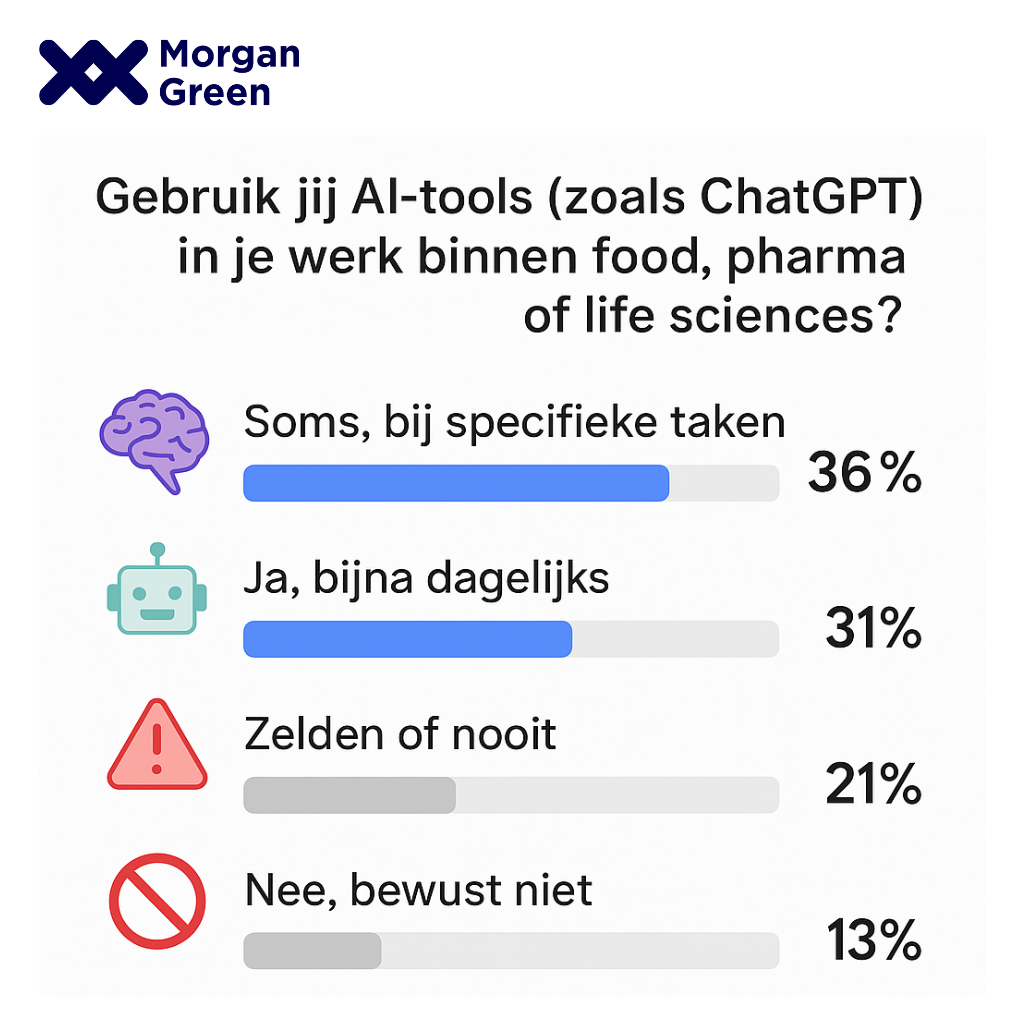

Wat zeggen professionals zelf? (Poll-analyse)

Uit ons eigen onderzoek onder professionals in pharma, food en life sciences blijkt dat AI-gebruik in het werkveld groeit – maar ook tot verdeeldheid leidt.

(bron: LinkedIn poll Morgan Green)

In de poll vroegen we: Gebruik jij AI-tools zoals ChatGPT in je werk binnen food, pharma of life sciences?

De resultaten:

Soms, bij specifieke taken – 36%

Ja, bijna dagelijks – 31%

Zelden of nooit – 21%

Nee, bewust niet – 13%

Wat opvalt? Meer dan 2 op de 3 respondenten zet AI regelmatig in, vooral voor rapportage, brainstorms of samenvattingen. Tegelijkertijd is er een kritische groep die AI bewust mijdt, uit zorgen over foutgevoeligheid of compliance.

Opvallend: veel gebruikers gaven aan dat ze zelf “leren door te doen”, zonder formeel beleid vanuit de organisatie. Dat betekent kansen én risico’s. Want zonder kaders over dataveiligheid, validatie of inzetbaarheid kan de output van AI al snel misleiden of zelfs conflicteren met regelgeving.

Conclusie van deze peiling: de behoefte aan duidelijk beleid groeit. AI-gebruik in het lab moet niet langer ‘wild west’ zijn, maar onderdeel worden van kwaliteitsgericht en verantwoord labwerk.

Wat zegt de praktijk? Inzichten uit Reddit: AI in HACCP en food safety

Op Reddit ontstaan steeds vaker discussies over AI-gebruik in voedselveiligheid – en die geven een eerlijker beeld dan veel whitepapers. In het thread “Has anyone tried to use AI to help with HACCP?” uit de r/KitchenConfidential-community, delen professionals uit keukens, QA en productie hun ervaringen met tools als ChatGPT in de praktijk.

Wat valt op?

Scepsis overheerst, vooral over de praktische toepasbaarheid. Veel respondenten vinden AI “interessant, maar onbetrouwbaar zonder menselijke controle”.

Ervaringen met promptdesign wisselen sterk. Sommigen gebruiken AI om HACCP-risico’s te simuleren of om SOP’s te herschrijven in eenvoudigere taal. Maar velen benoemen dat de antwoorden vaak te algemeen zijn, of niet voldoen aan de wettelijke eisen.

Compliance is de bottleneck. Gebruikers vrezen dat AI geen volledig zicht heeft op specifieke nationale richtlijnen of productgroepen, zoals gekoelde producten of allergenenbeheer. Een gebruiker noemt: “It’s a great brainstorm buddy, but not a regulatory tool.”

Toch wordt geëxperimenteerd. Vooral kleinere bedrijven proberen AI als ‘assistent’ bij documentatie of om zichzelf te trainen in HACCP-taken. Daarbij wordt herhaaldelijk gewaarschuwd: “Always verify, never assume.”

Deze community-discussie laat zien dat de werkvloer AI niet klakkeloos omarmt, maar wél actief onderzoekt. En precies dát is waar kansen liggen: door ervaringen te delen, kunnen best practices ontstaan die de kloof tussen technologische potentie en voedselveiligheid overbruggen.

Wat zijn ethische overwegingen bij AI-gebruik in life sciences?

AI in de life sciences roept grote ethische vragen op: hoe zorg je voor transparantie, veiligheid en menselijk toezicht? De inzet van ChatGPT en vergelijkbare tools raakt namelijk aan gevoelige thema’s zoals patiëntveiligheid, data-integriteit en productkwaliteit.

Een belangrijk risico: hallucinaties of foutieve aannames. Wanneer AI iets ‘bedenkt’ dat plausibel klinkt maar feitelijk onjuist is, en dit wordt zonder controle gebruikt in een lab- of QA-context, kunnen de gevolgen groot zijn. Denk aan foute interpretatie van toxicologische data, of onnauwkeurige rapportage bij audits.

Daarnaast speelt het probleem van bias. AI-modellen zijn getraind op datasets die niet altijd representatief zijn voor wetenschappelijke of ethische standaarden. Een voorbeeld hiervan zien we in onderzoek van Food Safety Magazine: AI kon gevaarlijke HACCP-informatie genereren die niet conform wetgeving was.

Oplossing? Ethisch AI-gebruik vraagt om:

Transparantie over hoe en wanneer AI wordt ingezet.

Toezicht door gecertificeerde kwaliteitsfunctionarissen.

Integratie van AI-gebruik in bestaande kwaliteitsrichtlijnen, zoals GxP en ISO.

Zo blijf je als organisatie niet alleen compliant, maar bouw je ook vertrouwen op bij klanten en toezichthouders.

Welke AI-tools zijn het meest geschikt voor professionals in deze sector?

Niet elke AI-tool is geschikt voor het lab. Betrouwbaarheid, herleidbaarheid en sectorrelevantie zijn cruciaal. Daarom zetten life sciences-professionals steeds vaker in op gespecialiseerde tools met specifieke validatiefuncties.

Een overzicht van bruikbare AI-toepassingen:

ChatGPT + plugins / GPTs: zoals LabGPT, ideaal voor structuur in SOP’s, rapporten en validatiedocumentatie.

ChatGPT Food Safety GPT: AI voor voedselveiligheid en HACCP-richtlijnen.

Food Industry GPT: AI voor receptontwikkeling, voedselanalyse en supply chain planning.

Custom NLP-oplossingen: op maat gebouwd voor QA/QC-processen, documentreview of traceerbaarheid in productie.

Let bij selectie op:

Herleidbaarheid: kunnen medewerkers begrijpen waarom een AI een bepaald antwoord geeft?

Validatiemogelijkheden: kan de output getoetst worden aan wet- en regelgeving?

Auditbaarheid: zijn prompts, versies en contexten achteraf terug te vinden?

Kortom, AI-tools moeten aansluiten bij bestaande compliance-eisen.

Zie ook:

👉 AI verandert pharma radicaal – mis deze ontwikkeling niet

Hoe bereiden vooruitstrevende organisaties zich nu al voor op AI?

Vooruitstrevende organisaties maken AI niet vrijblijvend – ze maken het strategisch. Ze erkennen het potentieel van tools als ChatGPT, maar combineren dat met een solide aanpak rondom risico’s, regelgeving en scholing.

Concreet betekent dat:

Het opstellen van AI-beleidskaders binnen QA-, R&D- en documentatieafdelingen.

Het trainen van medewerkers in AI-geletterdheid, zoals prompt design, bronverificatie en ethiek.

Het creëren van AI-governance-structuren, waarin multidisciplinaire teams toezicht houden op toepassingen.

Bijvoorbeeld: bedrijven in de pharma en voedselveiligheid nemen AI-gebruik op in hun ISO- en GxP-compliance-audits. Daarbij wordt getoetst op consistentie, herleidbaarheid en dataveiligheid. Zie ook dit blog over verantwoordelijkheden in QA en productie.

Verder blijkt uit de AI & Food Safety whitepaper van IAFP dat steeds meer retailers AI gebruiken voor realtime traceerbaarheid, temperatuurmonitoring en voorspellingen bij recalls, met succes.

Belangrijk: deze organisaties zien AI niet als vervanging van mensen, maar als versterking. De sleutel is balans tussen menselijk toezicht en slimme automatisering.

Conclusie: AI in de life sciences vraagt om slim gebruik én kritische reflectie

De inzet van ChatGPT en andere AI-tools in de pharma-, food- en life sciences-sector biedt ongekende kansen: van efficiëntere documentatie tot ondersteuning in kwaliteitsborging. Maar AI is géén wondermiddel. Onze eigen poll toont aan dat het gebruik sterk varieert – en juist die diversiteit onderstreept de behoefte aan beleid, training en toetsing.

De toekomst ligt niet in óf we AI gebruiken, maar hoe we dat op een verantwoorde, transparante en waardevolle manier doen. Van datastructurering tot ethische toetsing – de mens blijft essentieel. AI is een slimme assistent, maar het is aan de professional om scherp te blijven sturen.

Wil je meer leren over AI-verantwoordelijkheden en de rol van QA binnen deze context? Lees dan verder op:

Veelgestelde Vragen (FAQ)

1. Wat zijn de voordelen van ChatGPT voor labprofessionals in pharma en food?

ChatGPT helpt labmedewerkers bij het schrijven en structureren van rapportages, SOP’s en samenvattingen van vakliteratuur. Vooral in QA/QC en validatieprocessen kan het tijd besparen. Maar alleen als de output wordt gecontroleerd op nauwkeurigheid en correctheid. Het werkt vooral goed als startpunt voor taken die anders veel tijd kosten.

2. Is AI veilig om te gebruiken voor voedselveiligheid en HACCP?

AI kan HACCP-processen ondersteunen, maar is niet foutloos. Tools moeten worden gevalideerd tegen wetgeving en standaarden. Zie ook Food Safety Magazine, waar wordt gewaarschuwd voor onbetrouwbare interpretaties als AI zonder menselijk toezicht wordt ingezet. Gebruik AI dus als aanvulling – niet als eindverantwoordelijke.

3. Kun je ChatGPT inzetten bij audits of GxP-documentatie?

Ja, mits met beleid. AI-tools kunnen helpen bij het opstellen van documentstructuren, het herschrijven van complexe tekst of het nalezen op inconsistenties. Maar ze voldoen (nog) niet aan volledige GxP-richtlijnen. Interne richtlijnen, logging en verificatie zijn cruciaal als je AI gebruikt binnen gereguleerde omgevingen.

4. Wat zeggen professionals over AI-gebruik op de werkvloer?

Volgens onze eigen poll onder lab professionals in food/pharma gebruikt 67% AI regelmatig (soms of dagelijks), terwijl 33% dat bewust niet of zelden doet. De belangrijkste voordelen? Tijdwinst en structuur. De grootste zorgen? Onnauwkeurigheid, datasoevereiniteit en interpretatierisico’s. Zie de visual in dit artikel voor alle cijfers.

5. Wat is de beste aanpak om AI veilig te integreren in een food/pharma omgeving?

Start met AI-beleidskaders op afdelingsniveau. Zorg voor training in AI-geletterdheid (bijv. promptdesign, interpretatie, risicobewustzijn). Kies alleen gevalideerde AI-tools. En gebruik deze in combinatie met menselijk toezicht. Zie ook de ChatGPT food safety GPT voor toepassingen die specifiek ontwikkeld zijn voor deze sector.